REGISTRO DOI: 10.5281/zenodo.10880168

Weider Silva Pinheiro

RESUMO: O advento e a popularização das inteligências artificiais generativas, ocorridas a partir de 2022, trouxe à tona discussões acerca das possibilidades trazidas por essas tecnologias, e tendo em vista os diversos usos possíveis de ferramentas como o ChatGPT, principalmente no que tange o contexto educacional brasileiro e o impacto na educação de crianças e jovens, a regulamentação das IA’s se torna cada vez mais urgente. A aparente qualidade e confiabilidade dos textos gerados por IA’s generativas, a possibilidade de ofensa à direitos autorais, a baixa originalidade e autenticidade das produções, assim como sua capacidade de criar informações totalmente fabricadas de forma a cumprir a tarefa dada pelo usuário e seu o potencial de disseminação de desinformação alertam para a necessidade de regulamentação, podendo prejudicar estudantes em todos os estágios de sua vida escolar e acadêmica — desde o correto desenvolvimento de pensamento crítico à aspectos éticos. O projeto de lei n° 2.338/23 visa mitigar possíveis riscos e vieses do uso da IA, não deixando à cargo do usuário a verificação dos conteúdos produzidos e informações dadas por tais ferramentas, ou à cargo do professor a correta utilização da tecnologia. Porém é preciso ainda lançar atenção ao abismo social existente no Brasil, pois o cenário que se vislumbra é de aumento exponencial da precarização do ensino e a marginalização de grupos que sequer adentraram completamente ou suficientemente, no mundo digital.

Palavras-chave: Inteligência artificial. Educação e ensino. Regulamentação. Plágio e desinformação.

ABSTRACT: The advent and popularization of generative artificial intelligence, which occurred from 2022 onwards, brought to light discussions about the possibilities brought by these technologies, and taking into account the different possible uses of tools such as ChatGPT, especially in relation to the Brazilian educational context and the impact on the education of children and young people, the regulation of AI’s becomes increasingly urgent. The apparent quality and reliability of texts generated by generative AI’s, the possibility of copyright infringement, the low originality and authenticity of the productions, as well as their ability to create completely fabricated information in order to fulfill the task given by the user and their potential of dissemination of misinformation warn of the need for regulation, which could harm students at all stages of their school and academic life — from the correct development of critical thinking to ethical aspects. Bill No. 2,338/23 aims to mitigate possible risks and biases in the use of AI, not leaving it up to the user to verify the content produced and information provided by such tools, or the teacher to ensure the correct use of technology. However, it is still necessary to pay attention to the social abyss that exists in Brazil, as the scenario that is envisaged is an exponential increase in the precariousness of education and the marginalization of groups that have not even fully or sufficiently entered the digital world.

Keywords: Artificial intelligence. Education and teaching. Regulation. Plagiarism and misinformation.

INTRODUÇÃO

Desde o surgimento do ChatGPT®, uma inteligência artificial do tipo “modelo de linguagem grande” (LLMs), também chamada generativa, cuja função é responder às perguntas e pedidos dos usuários de forma similar a uma conversa — daí sua definição como um chatbot, um programa computacional que simula a conversação humana — a discussão acerca das possibilidades e avanços trazidos por essas tecnologias, apesar se não ser algo recente, alcançou novos patamares, principalmente no que diz respeito à sua regulamentação.

Isso ocorre porque as diversas inteligências artificiais generativas, não apenas as de geração textual, mas também de imagens, se popularizaram muito rapidamente, seja devido à gratuidade de acesso e aos vários usos possíveis dessas tecnologias, indo desde a conversação entre usuário e máquina, seu uso como ferramenta de busca, tradução, e até a criação de imagens e textos ortograficamente corretos a partir de comandos simples[1].

Tal popularização lançou luz à possíveis problemas das IA’s generativas. No caso específico das IA generativas de texto, cujo algoritmo é capaz de gerar respostas minimamente satisfatórias aos comandos dos usuários ao compilar os dados disponíveis em seu banco de dados, estas apresentam vieses, imprecisões e fornecimento de informações que podem ser consideradas nocivas, assim como a capacidade de criar informações falsas para cumprir a tarefa que lhe foi dada[2], podendo ainda causar dependência ao usuário, problemas emocionais e psicológicos[3].

Diversos usuários vem utilizando esse tipo de ferramenta para criação de textos diversos, como roteiros, livros e artigos jornalísticos, e até mesmo textos acadêmicos e em atividades escolares[4], o que levanta não apenas questões éticas, de integridade profissional e possíveis plágios[5], mas que também pode se mostrar prejudiciais ao aprendizado de estudantes justamente devido aos vieses, imprecisões e informações falsas que podem ser fornecidas pelas ferramentas, tornando-se um desafio aos educadores.

Este artigo tem como objetivo trazer luz à problemática relacionada ao uso de inteligências artificiais generativas, discutindo as potencialidades e desafios dessas ferramentas no contexto educacional brasileiro, em especial no que tange os impactos na educação de crianças e jovens, a atuação do docente e da necessidade de regulamentação como meio de mitigação de riscos e vieses.

METODOLOGIA

Para cumprimento dos objetivos do presente estudo, recorreu-se à pesquisa bibliográfica, que consiste na coleta de dados secundários, ou seja, já publicados e analisados por outros pesquisadores, tais como livros e artigos científicos. Sua principal função é o aprofundamento do conhecimento, possibilitando ainda sua atualização[6].

Utilizou-se ainda dados primários como fonte de pesquisa, ou seja, foi realizada ainda uma pesquisa documental. De forma geral, a pesquisa documental se utiliza de referências originais que ainda não receberam tratamento analítico ou que podem ser reanalisadas, com o objetivo de trazer-lhes novas interpretações[7]. Podem ser relatórios, documentos históricos e outros.

Trata-se, portanto, de uma pesquisa do tipo qualitativa, que permite tanto uma abordagem racional quanto intuitiva, seja na execução da pesquisa em si ou na análise dos dados coletados, permitindo uma compreensão das diversas perspectivas que podem se apresentar[8], além de seu enfoque exploratório, possibilitando trazer maior familiaridade com os temas em estudo e a criação de hipóteses variadas, visando desenvolver ou mesmo esclarecer conceitos e ideias[9].

INTELIGÊNCIAS ARTIFICIAIS GENERATIVAS

As pesquisas na área de inteligência artificial visam, de acordo com Floridi e Chiriatti[10], criar sistemas que executem tarefas mais complexas, desenvolvendo-se algoritmos ou mesmo as chamadas redes neurais, tornando-as capazes de resolver situações que, normalmente, exigiriam raciocínio humano.

Surgiram de estudos que visavam compreender se computadores poderiam apresentar a mesma inteligência humana, imitando o funcionamento do cérebro[11]. A capacidade de processamento, de aprendizado ou de tomada de decisões das inteligências artificiais baseia-se não apenas na forma como seus algoritmos ou suas redes neurais foram programados, mas também nas bases de dados que as alimentam[12], sejam elas distribuídas pela internet ou localmente[13]. Em linhas gerais, pode-se dizer que as máquinas são treinadas através de seu banco de dados e algoritmos, o que se denomina “aprendizado de máquina”.

As inteligências artificiais podem ser aplicadas em diversas áreas da sociedade, seja na indústria, nas áreas médicas e demais ciências, especialmente pela possibilidade de se processar dados e identificar padrões mais rapidamente do que o raciocínio humano permitiria.

Estão presentes ainda na vida cotidiana, seja na forma de assistentes de busca ou de assistentes virtuais (como as assistentes Alexa, da Amazon, ou Siri, da Apple), que podem auxiliar o indivíduo na organização e controle de sua rotinas, hábitos e saúde.

As IA’s generativas, ou Redes Adversárias Generativas (GANs), são redes neurais artificiais que não surgiram com o ChatGPT®, tendo origem em meados de 2010. Sua função é gerar conteúdos originais, como já citado, como textos e imagens, e até mesmo músicas, códigos computacionais e outros, sendo muito utilizado por programadores e pesquisadores[14].

Santo et al. explicam o funcionamento das GANs:

[…] se trata de uma área da IA que tem como objetivo criar softwares capazes de gerar conteúdo original, como textos, imagens e música. Esses softwares são dotados de algoritmos de aprendizado de máquina, especialmente redes neurais, para aprender a partir de grandes volumes de dados e produzir novos conteúdos com base nessa aprendizagem. Porém, gerarão novos dados, semelhantes aos dados utilizados para aprendizagem, mas que podem ser únicos e originais. Esse processo de geração de conteúdo consiste na etapa de extrair informações das instruções humanas e gerar conteúdo de acordo com as intenções extraídas[15].

O surgimento do ChatGPT® em 2022, uma ferramenta que consegue produzir informações novas a partir de dados já existentes em sua base de dados, fez com que tecnologias desse tipo alcançassem o público geral, acelerando o desenvolvimento e o surgimento de novas inteligências artificiais generativas, popularizando o acesso a elas e trazendo também novos usos, como os já citados: criação de textos diversos, roteiros, artigos, livros e outros.

Os problemas da IA generativa

Os novos usos dados à inteligência artificial pela população geral acenderam discussões sobre ética profissional, uma vez que a utilização dessas ferramentas para criação de textos e imagens para produções acadêmicas, artísticas e até mesmo literárias pode colocar em xeque a integridade de pesquisadores e profissionais de diversas áreas.

De acordo com a revista científica Nature:

A grande preocupação na comunidade de investigação é que estudantes e cientistas possam falsamente fazer passar o texto escrito pelo LLM como se fosse seu, ou usar LLMs de uma forma simplista (como para realizar uma revisão incompleta da literatura) e produzir um trabalho que não é fiável. Vários preprints e artigos publicados já creditaram ao ChatGPT a autoria formal[16].

Assim, visando reduzir problemas éticos, muitos usuários, ao publicarem conteúdos produzidos pela inteligência artificial generativa a partir dos comandos dados por eles, acabam creditando a própria ferramenta como coautor da obra ou do texto acadêmico[17] — o que pode não ser efetivo.

A revista Nature, ao estabelecer regras para uso de IA na construção de trabalhos acadêmicos, artigos e pesquisas, não aceita que tecnologias do tipo LLM como coautores, pois a atribuição de autoria é dada em decorrência da realização de trabalho, o que não pode ser aplicado à ferramenta[18], acrescentando ainda que, caso o pesquisador se utilize de quaisquer tipos de inteligência artificial na execução da pesquisa, tal utilização precisa estar devidamente descrita na metodologia.

Em outra análise, fatores como originalidade e autenticidade podem se perder devido ao caráter automatizado dos textos e imagens produzidos pela IA, bem como a qualidade das escritas acadêmicas e da produção artística/literária em geral[19], já que a produção das IA’s generativas não trazem, por si, algo novo, apenas mesclando conteúdos já existentes em uma resposta que seja satisfatória àquilo que o usuário solicita.

Há ainda que se falar em direitos autorais. É preciso frisar que a questão do plágio, quando se fala em inteligências artificiais generativas, sejam elas textuais ou não, é sempre um risco[20]. Isso ocorre porque, como explicitado acima, são ferramentas que se baseiam apenas em sua própria base de dados para gerar as respostas, e não é possível saber exatamente quais textos a compõe.

Assim, as respostas dadas podem ter origem em textos protegidos por direitos autorais ou utilizando como base, nos casos de geradores de imagem, desenhos, fotos ou pinturas criadas por outros profissionais e artistas, caracterizando plágio — o que pode acarretar uma série de problemas jurídicos futuros para as plataformas, empresas e também para os usuários que se utilizarem das ferramentas como fonte de produção textual e artística.

Um outro problema está relacionado à capacidade dessas ferramentas de “mentir” para o usuário como forma de sempre entregar uma resposta positiva à solicitação dada[21], trazendo consigo grande potencial de disseminação de desinformação.

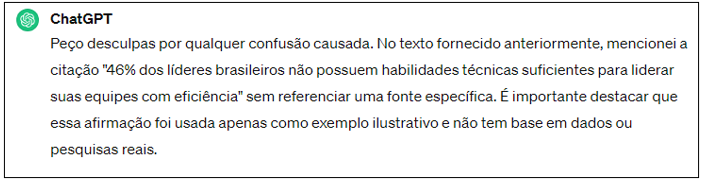

Realizando um breve teste no ChatGPT®, onde foi pedido que se criasse um texto com o tema “Liderança nas organizações brasileiras na atualidade”. Ao pedir que fosses citadas as fontes dos dados apresentados, pôde-se obter a comprovação dessa capacidade de criar informações falsas.

Com base no texto produzido, questionou-se a fonte da informação dada de que “46% dos líderes brasileiros não possuem habilidades técnicas suficientes para liderar suas equipes com eficiência”. Como pode-se verificar abaixo, a própria ferramenta afirma que não se baseou em dados reais para construção do texto:

Figura 1: Resposta dada pelo ChatGPT® acerca de dados fornecidos:

Fonte: OpenAITM, 2023. Com comandos elaborados pelo autor.

Ou seja, a ferramenta traz informações ortograficamente corretas e que podem ser consideradas satisfatórias, porém não são necessariamente reais, e sim totalmente fabricadas de acordo com o banco de dados.

Barreto e Ávila[22] alertam que esse potencial de disseminação de desinformação por parte das IA’s generativas podem ter origem na falta de informações precisas ou do uso de dados incorretos no treinamento da IA, pois a máquina não tem acesso a todo o conhecimento disponível, limitando-se à sua base de dados, assim como ao aprendizado mútuo: essas ferramentas tem capacidade para se atualizar com base nas interações e nos feedbacks trazidos pelos próprios usuários.

Magaly Prado, pesquisadora do Instituto de Estudos Avançados (IEA) da USP, complementa:

Mas basta perseguir a lógica quando quem pergunta, seja humano ou outro bot, ao produzir um prompt (comando de texto e, de preferência, contexto) solicitando respostas de algo falso que, axiomaticamente, o resultado será igualmente falso. Nesse caso, não se trata de algo fora do alcance da informação, um erro ou alucinação — o que, por vezes, ocorre: é falso mesmo, exatamente de acordo com o que foi solicitado, comando após comando, amplificando a já instalada desordem informacional[23].

Prado reitera que a combinação de ferramentas pode ter um efeito nocivo ainda maior na mão de pessoas imprudentes ou mal intencionadas, criando textos falaciosos e, com a possibilidade de criar áudios falsos simulando a fala de pessoas reais, bem como de vídeos com deepfake, elevar a disseminação de desinformação à patamares mais elevados[24], facilitando sua disseminação e acesso.

Há ainda relatos de elaboração de fontes bibliográficas falsas, citando-se obras, autores, relatórios e até links de acesso totalmente fabricados, e para além disso, o banco de dados utilizado para treinamento do ChatGPT® data de 2021 e 2022, podendo ser considerados dados desatualizados, prejudicando ainda mais a geração de respostas corretas aos comandos dos usuários por, em muitos aspectos, já não representarem elementos mais recentes[25].

IA NA EDUCAÇÃO DE CRIANÇAS E JOVENS: NECESSIDADE DE REGULAMENTAÇÃO

É preciso, à luz dos problemas levantados até aqui, identificar o potencial da IA generativa na educação de crianças e jovens, sejam estes nocivos ou benéficos, assim como apontar os aspectos a serem considerados para regulamentação das tecnologias no Brasil — que encontra origem no projeto de lei n° 2.338, de 2023, de autoria do Senador Rodrigo Pacheco (PSD/MG)[26].

A primeira questão a ser discutida é relacionada ao plágio. A dificuldade em saber se os conteúdos produzidos pelas IA’s generativas caracterizariam plágio gera impactos negativos à educação, prejudicando estudantes em todos os estágios de sua vida escolar e acadêmica.

Enquanto discentes, principalmente quando se fala dos mais jovens, estes podem ainda não ter desenvolvido as ferramentas cognitivas necessárias para entender o funcionamento desse tipo de instrumento digital e dos riscos de estarem se apropriando de um texto gerado por IA como se fosse de autoria própria ou de um conhecimento que não foi por si produzido — citando como exemplo processos formais por plágio já movidos no exterior contra a criadora do ChatGPT®, a OpenAITM[27] podendo até acarretar em ações contra os usuários que publicaram os textos “copiados”.

De acordo com o citado projeto de lei[28], deverá ser considerado como ofensa à direitos autorais quando houver a reprodução, exibição ou disseminação da obra original em si; quando o uso das obras não ocorra na medida necessária para o objetivo a ser alcançado; quando prejudique de forma injustificada os interesses econômicos dos titulares das obras e ao concorrer com a exploração normal das obras. A obtenção dessas obras componentes do banco de dados da IA também deverá se dar de forma legítima.

Quanto à responsabilização do usuário que se apropriou de textos feitos pela IA, não há menções específicas no projeto de lei n° 2.338/23, devendo a plataforma tomar medidas para garantir ao público a transparência no que diz respeito aos riscos associados ao sistema de inteligência artificial visando a mitigação de riscos, existentes ou esperados[29], como forma de proteção ao usuário.

Atualmente, o entendimento é de que, de acordo com a Lei de Direitos Autorais[30], conteúdos criados pelo ChatGPT® não caracterizariam plágio em um primeiro momento, não podendo o usuário ser responsabilizado juridicamente por não haver identificação do real autor.

Porém a possibilidade de responsabilização direta do usuário por plágio nesses casos é algo que não se pode desconsiderar, primeiramente por se tratar de um tema recente e sem precedente no meio jurídico, não havendo ainda regulamentação legal para tal situação. Em outras palavras, a possível responsabilização do usuário, a depender do uso dado à essas ferramentas, mesmo que esta se dê apenas quanto à aspectos éticos, pode também vir a ser discutida.

Já as informações potencialmente imprecisas ou até falsas dadas por inteligências artificiais como o ChatGPT® podem trazer grandes prejuízos ao aprendizado de estudantes, em que a necessidade de regulamentação das IA’s perpassa ainda a discussão trazida sobre seu potencial de transmissão de desinformação.

Utilizando de IA’s generativas, por exemplo, como auxiliar na execução das atividades escolares[31], um estudante pode tomar aquela informação imprecisa ou falsa como verdade, levando esse “conhecimento” adquirido para sua vida escolar e cotidiana.

Estes alunos ainda podem não entender o dilema ético que pode se apresentar, podem não ter a capacidade de criar formas de utilizar a IA para benefício do aprendizado, ou mesmo podem não ter aprendido como realizar buscas por dados reais para interpretar ou verificar as referências fornecidas pela IA, em especial devido às respostas trazidas que são, ao menos aparentemente, satisfatórias.

Há ainda o risco de prejuízos no desenvolvimento de pensamento crítico dos estudantes que, ao invés de tentar resolver os problemas e atividades propostas por conta própria, recorram à respostas prontas trazidas por um chatbot, que irá “pensar” em seu lugar.

Entendendo todos esses fatores, recai sobre o professor a responsabilidade de verificação e orientação dos estudantes quanto os pontos positivos e principalmente sobre os pontos negativos do uso dessas ferramentas — compreendendo que proibir o uso dessas tecnologias, controlando o comportamento de cada aluno, não é algo possível de se fazer.

É papel do professor não apenas ministrar conteúdo aos alunos, mas sim auxiliar no desenvolvimento das ferramentas cognitivas que favoreçam o aprendizado, favoreçam a abstração e a criação de pensamento crítico, e o surgimento de novas tecnologias sempre será um desafio no cumprimento das funções exercidas pelos docentes.

Souza[32], em seu estudo acerca dos desafios da docência ante o avanço tecnológico, coloca que as tecnologias digitais trazem um caráter dinamizador para a prática pedagógica, tendo “[…] a capacidade de melhorar o trabalho do professor em sala de aula; além de ‘falar a língua’ do aluno, facilitando assim a aprendizagem por parte das gerações mais novas”, em outras palavras, adequando a comunicação entre professores e alunos das gerações mais novas.

Tal afirmação abre portanto a discussão acerca do uso de tecnologias digitais não apenas na comunicação e adaptação do ensino junto à essas tecnologias, mas também no próprio trabalho do professor, apoiando a realização de rotinas burocráticas, correção de provas, correção de erros gramaticais, análise de dados em pesquisas e de dados acerca dos resultados apresentados pelos alunos, e outros.

Para ser capaz de integrar as novas tecnologias e as funções docentes, Souza[33] aborda a necessidade de formação continuada dos professores, pois apenas com o aprimoramento constante do docente será possível transformar as novas formas de transmissão de conteúdo e de pesquisa em aprendizagem efetiva.

Aruda afirma que a estrutura escolar também precisa estar alinhada ao trabalho do professor para a correta e eficaz aplicação de IA’s generativas na prática educacional, incorporando-se as vantagens que tais ferramentas podem trazer ao ensino e ao trabalho diário do professor. Sua afirmação se ancora nas iniciativas adotadas em escolas e universidades pelo mundo de introdução e aprimoramento dessas tecnologias para uso em atividades pedagógicas:

Há casos em que escolas norte-americanas começaram a adotar tutores inteligentes, que são, na verdade, aplicações com acesso a tecnologias como o ChatGPT ou Bard da Google e que possuem treinamentos mais elaborados e vinculados aos conteúdos ministrados pela escola. A Universidade de Harvard, inclusive, já iniciou a oferta de um curso vinculado à codificação de programas que utiliza IA generativa como tutor virtual individual do estudante[34].

Assim, entende-se que deixar o professor, por si só, seja responsável pela integração de novas tecnologias ao ensino, não poderá trazer resultados efetivos ao aprendizado discente.

CONCLUSÃO

O projeto de lei n° 2.338/23[35] estabelece em seus artigos 1° e 2°, que a regulamentação do uso da IA no Brasil deve ter como fundamento o respeito aos direitos humanos e aos valores democráticos; a igualdade, a não discriminação, o desenvolvimento tecnológico e a inovação; o acesso à informação e à educação; a conscientização sobre os sistemas de inteligência artificial e suas aplicações; bem como a necessidade de prestação de contas, responsabilização e reparação integral de danos; bem como a prevenção, precaução e mitigação de riscos sistêmicos derivados de usos intencionais ou não intencionais e de efeitos não previstos de sistemas de inteligência artificial, entre outros fatores e medidas de governança.

Assim, exige-se das empresas a responsabilidade por mitigar possíveis riscos e vieses do uso da IA, não apenas as do tipo generativas, bem como a atualização constante e baseada em diversidade, não deixando à cargo do usuário a verificação dos conteúdos produzidos e informações dadas por tais ferramentas, evitando a desinformação, mas também buscando eliminar a disseminação de vieses sociais, estruturais ou discriminatórios que podem ser perpetuados ou mesmo ampliados pela tecnologia[36].

Percebe-se a preocupação legislativa acerca da confiabilidade dessas ferramentas, de sua aplicabilidade e pelo desenvolvimento tecnológico e inovação, sendo possível verificar, ante o exposto ao longo do texto, a possibilidade de haver resultados benéficos ao aprendizado de discentes e ao trabalho docente ao traçar iniciativas de integração da IA com a prática pedagógica.

Porém, ao considerarmos que o projeto de lei n° 2.338/23 ainda passará por tramitação, assim como ao considerarmos a forma como a IA generativa se apresenta hoje, com a necessidade de um aprimoramento profundo das respostas dadas pela ferramenta, a verificação da veracidade das informações trazidas e ainda, como cita Aruda[37], pela necessidade de treinamento específico das ferramentas para uso nas escolas, essa integração efetiva parece ainda distante.

As plataformas têm adotado formas próprias de detecção de textos fabricados por IA[38], bem como o estabelecimento de diretrizes de utilização para os usuários, porém, como demonstra Ferrari[39], ao questionar ao ChatGPT® sobre aspectos sensíveis à prática educacional, a própria plataforma aponta que há riscos de aumento de plágio, já discutido anteriormente, e coloca a responsabilidade de guiar os discentes apenas sob as costas do professor.

Citando especificamente o contexto educacional brasileiro, apontando principalmente para a disparidade existente entre educação pública e privada, a precarização e pouca atratividade da docência, e o abismo social entre os alunos de ambos os sistemas de educação — aspecto escancarado na pandemia, deixando claro que o acesso ao digital está bem longe de ser universal —, é de fundamental importância e urgência que se paute, não apenas a temática da inclusão e da regulamentação dos meios digitais, mas também da inserção de mecanismos de IA no contexto da educação.

Isso porque, como consequência direta e abstraindo brevemente das falhas e limitações dessa ferramentas, o cenário que se vislumbra é de aumento exponencial da precarização do ensino, em especial aquele oferecido às classes mais baixas, o que, por sua vez, tende a retroalimentar as diferenças sociais preexistentes e a marginalização de grupos que sequer adentraram completamente ou suficientemente, no mundo digital.

REFERÊNCIAS BIBLIOGRÁFICAS

ARUDA, Eucidio Pimenta. Inteligência artificial generativa no contexto da transformação do trabalho docente. Educação em Revista, [S.L.], v. 40, p. 1-6, 2024. FapUNIFESP (SciELO). http://dx.doi.org/10.1590/0102-469848078.

BARRETO, Alana Maria Passos; ÁVILA, Flávia de. A inteligência artificial diante da integridade científica: um estudo sobre o uso indevido do ChatGPT. Revista Direitos Culturais, [S.L.], v. 18, n. 45, p. 91-106, 7 set. 2023. Universidade Regional Integrada do Alto Uruguai e das Missões. http://dx.doi.org/10.31512/rdc.v18i45.1373.

BRASIL. Lei Nº 9.610, de 19 de fevereiro de 1998. Altera, atualiza e consolida a legislação sobre direitos autorais e dá outras providências. Brasília, Disponível em: https://www.planalto.gov.br/ccivil_03/leis/l9610.htm. Acesso em: 15 mar. 2024.

BRASIL. Projeto de Lei nº 2.338. Publicado em 04 de maio de 2023. Dispõe sobre o uso da Inteligência Artificial. Brasília, DF: Câmara dos Deputados, 2023. Disponível em: https://www25.senado.leg.br/web/atividade/materias/-/materia/157233. Acesso em: 14 mar. 2024.

EURONEWS. Conversa com Inteligência Artificial leva homem ao suicídio. 2023. Artigo publicado por Euronews Portugal em 01 de abril de 2023. Disponível em: https://pt.euronews.com/next/2023/04/01/conversa-com-inteligencia-artificial-leva-homem-ao-suicidio. Acesso em: 01 mar. 2024.

FERRARI, Leon. Perguntamos ao ChatGPT: Como a inteligência artificial muda o ensino e como lidar com o plágio? 2023. Artigo publicado por Estadão em 31 de janeiro de 2024. Disponível em: https://www.estadao.com.br/educacao/perguntamos-ao-chatgpt-quais-impactos-ele-pode-causar-na-educacao-confira-as-respostas/. Acesso em: 15 mar. 2024.

FLORIDI, Luciano; CHIRIATTI, Massimo. GPT-3: its nature, scope, limits, and consequences. Minds And Machines, [S.L.], v. 30, n. 4, p. 681-694, 1 nov. 2020. Springer Science and Business Media LLC. http://dx.doi.org/10.1007/s11023-020-09548-1.

GONÇALVES, Felipe Halex Gomes da Silva; SALLES, Juliana Marques. Como se comporta a inteligência artificial mediante plágio e direito autoral. Revista Científica Eletrônica de Ciências Aplicadas da FAIT, Itapeva, n. 22, p. 1-14, maio 2023.

HERNANDES, Raphael. GPT evolui muito, problemas permanecem e perigos aumentam. Artigo publicado por Folha de São Paulo em 28 de março de 2023. Disponível em: https://www1.folha.uol.com.br/tec/2023/03/gpt-evolui-muito-problemas-permanecem-e-perigos-aumentam.shtml. Acesso em: 03 mar. 2024.

KIRCHNER, Jan Hendrik; AHMAD, Lama; AARONSON, Scott; LEIKE, Jan. Novo classificador de IA para indicar texto escrito por IA. 2023. Elaborado por OpenAI. Disponível em: https://openai.com/blog/new-ai-classifier-for-indicating-ai-written-text. Acesso em: 15 abr. 2024.

LIM, Weng Marc; GUNASEKARA, Asanka; PALLANT, Jessica Leigh; PALLANT, Jason Ian; PECHENKINA, Ekaterina. Generative AI and the future of education: ragnarök or reformation? a paradoxical perspective from management educators. The International Journal Of Management Education, [S.L.], v. 21, n. 2, p. 100790, jul. 2023. Elsevier BV. http://dx.doi.org/10.1016/j.ijme.2023.100790.

MÜLLER, William Henrique; SILVEIRAS, Raphael. A Evolução E A Regulamentação Da Inteligência Artificial No Brasil: uma perspectiva histórica e conceitual. Revista Interciência, Catanduva, v. 1, n. 11, p. 2-10, jul. 2023. IMES Catanduva. Disponível em: https://edisciplinas.usp.br/mod/resource/view.php?id=4982647. Acesso em: 05 mar. 2024.

NATURE. Para autores: Submissão inicial. 2024. Disponível em: https://www.nature.com/nature/for-authors/initial-submission. Acesso em: 15 mai. 2024.

NATURE. Tools such as ChatGPT threaten transparent science; here are our ground rules for their use. Editorial, 2023. Disponível em: https://www.nature.com/articles/d41586-023-00191-1. Acesso em: 15 mai. 2024.

NEVES, José Luís. Pesquisa qualitativa: características, usos e possibilidades. Caderno de Pesquisas em Administração, São Paulo, v. 1, n. 3, p. 1-5, jun./dez. 1996.

OLIVEIRA, Maxwell Ferreira de. Metodologia Científica: um manual para a realização de pesquisas em administração. um manual para a realização de pesquisas em administração. 2011. UNIVERSIDADE FEDERAL DE GOIÁS – CAMPUS CATALÃO – CURSO DE ADMINISTRAÇÃO. Disponível em: https://files.cercomp.ufg.br/weby/up/567/o/Manual_de_metodologia_cientifica_-_Prof_Maxwell.pdf. Acesso em: 04 mar. 2024.

OPENAI. ChatGPT-3.5. Disponível em: https://chat.openai.com/. 2023. Acesso em: 04 mar. 2024.

PIANA, Maria Cristina. A construção do perfil do assistente social no cenário educacional [online]. São Paulo: Editora UNESP; São Paulo: Cultura Acadêmica, 2009. 233 p. ISBN 978-85-7983-038-9. Available from SciELO Books.

PRADO, Magaly. O poder da inteligência artificial no cruzamento entre ChatGPT e deepfakes. Jornal da USP. Jul. 2023. Disponível em https://jornal.usp.br/artigos/o-poder-da-inteligencia-artificial-no-cruzamento-entre-chatgpt-e-deepfakes/. Acesso em 13 mar. 2024.

QI, Xiang; ZHU, Zheng; WU, Bei. The promise and peril of ChatGPT in geriatric nursing education: what we know and do not know. Aging And Health Research, [S.L.], v. 3, n. 2, p. 100136, jun. 2023. Elsevier BV. http://dx.doi.org/10.1016/j.ahr.2023.100136.

RFI. Inteligência artificial é suspeita de ter incentivado homem a cometer suicídio na Bélgica. 2023. Artigo publicado por RFI – Rádio França Internacional em 31 março 2023. Disponível em: https://www.rfi.fr/br/europa/20230331-intelig%C3%AAncia-artificial-%C3%A9-suspeita-de-ter-incentivado-homem-a-cometer-suic%C3%ADdio-na-b%C3%A9lgica. Acesso em: 01 mar. 2024.

SANTO, Eniel do Espírito; ROSA, Flávia Goulart Mota Garcia; SILVA, Camila Bezerra da; BORDAS, Miguel Angel Garcia. Um mosaico de ideias sobre a inteligência artificial generativa no contexto da educação. In: ALVES, Lynn (org.). Inteligência artificial e educação: refletindo sobre os desafios contemporâneos. Salvador / Feira de Santana: Editora da Universidade Federal da Bahia / UEFS Editora, 2023. Cap. 3. p. 51-69.

SOUSA, Angélica Silva de; OLIVEIRA, Guilherme Saramago de; ALVES, Laís Hilário. A Pesquisa Bibliográfica: princípios e fundamentos. Cadernos da Fucamp, [S.I.], v. 20, n. 43, p. 64-83. 2021. Disponível em: https://revistas.fucamp.edu.br/index.php/cadernos/article/view/2336. Acesso em: 03 mar. 2024.

SOUZA, Elaine Antônia de. A gestão escolar e as tecnologias digitais: a implementação de um projeto e os desafios da prática pedagógica. 2022. 152 f. Dissertação (Doutorado) – Curso de Educação (Área de Especialidade em Administração Educacional), Instituto de Educação, Universidade de Lisboa, Lisboa, 2022. Disponível em: https://repositorio.ul.pt/handle/10451/56663. Acesso em: 15 abr. 2024.

TEIXEIRA, Pedro S. ChatGPT está nos tribunais por plágio e difamação, mas tema ainda não chegou ao Brasil. 2023. Artigo publicado por Folha de São Paulo em 30 de agosto de 2023. Disponível em: https://www1.folha.uol.com.br/tec/2023/08/chatgpt-esta-nos-tribunais-por-plagio-e-difamacao-mas-tema-ainda-nao-chegou-ao-brasil.shtml. Acesso em: 15 mar. 2024.

[1] LIM, Weng Marc; GUNASEKARA, Asanka; PALLANT, Jessica Leigh; PALLANT, Jason Ian; PECHENKINA, Ekaterina. Generative AI and the future of education: ragnarök or reformation? a paradoxical perspective from management educators. The International Journal Of Management Education, [S.L.], v. 21, n. 2, p. 100790, jul. 2023. Elsevier BV. http://dx.doi.org/10.1016/j.ijme.2023.100790.

[2] HERNANDES, Raphael. GPT evolui muito, problemas permanecem e perigos aumentam. Artigo publicado por Folha de São Paulo em 28 de março de 2023. Disponível em: https://www1.folha.uol.com.br/tec/2023/03/gpt-evolui-muito-problemas-permanecem-e-perigos-aumentam.shtml. Acesso em: 03 mar. 2024.

[3] RFI. Inteligência artificial é suspeita de ter incentivado homem a cometer suicídio na Bélgica. 2023. Artigo publicado por RFI – Rádio França Internacional em 31 março 2023. Disponível em: https://www.rfi.fr/br/europa/20230331-intelig%C3%AAncia-artificial-%C3%A9-suspeita-de-ter-incentivado-homem-a-cometer-suic%C3%ADdio-na-b%C3%A9lgica. Acesso em: 01 mar. 2024. / EURONEWS. Conversa com Inteligência Artificial leva homem ao suicídio. 2023. Artigo publicado por Euronews Portugal em 01 de abril de 2023. Disponível em: https://pt.euronews.com/next/2023/04/01/conversa-com-inteligencia-artificial-leva-homem-ao-suicidio. Acesso em: 01 mar. 2024.

[4] QI, Xiang; ZHU, Zheng; WU, Bei. The promise and peril of ChatGPT in geriatric nursing education: what we know and do not know. Aging And Health Research, [S.L.], v. 3, n. 2, p. 100136, jun. 2023. Elsevier BV. http://dx.doi.org/10.1016/j.ahr.2023.100136.

[5] BARRETO, Alana Maria Passos; ÁVILA, Flávia de. A inteligência artificial diante da integridade científica: um estudo sobre o uso indevido do ChatGPT. Revista Direitos Culturais, [S.L.], v. 18, n. 45, p. 91-106, 7 set. 2023. Universidade Regional Integrada do Alto Uruguai e das Missões. http://dx.doi.org/10.31512/rdc.v18i45.1373. / GONÇALVES, Felipe Halex Gomes da Silva; SALLES, Juliana Marques. Como se comporta a inteligência artificial mediante plágio e direito autoral. Revista Científica Eletrônica de Ciências Aplicadas da FAIT, Itapeva, n. 22, p. 1-14, maio 2023.

[6] SOUSA, Angélica Silva de; OLIVEIRA, Guilherme Saramago de; ALVES, Laís Hilário. A Pesquisa Bibliográfica: princípios e fundamentos. Cadernos da Fucamp, [S.I.], v. 20, n. 43, p. 64-83. 2021. Disponível em: https://revistas.fucamp.edu.br/index.php/cadernos/article/view/2336. Acesso em: 03 mar. 2024.

[7] PIANA, Maria Cristina. A construção do perfil do assistente social no cenário educacional [online]. São Paulo: Editora UNESP; São Paulo: Cultura Acadêmica, 2009. 233 p. ISBN 978-85-7983-038-9. Available from SciELO Books.

[8] NEVES, José Luís. Pesquisa qualitativa: características, usos e possibilidades. Caderno de Pesquisas em Administração, São Paulo, v. 1, n. 3, p. 1-5, jun./dez. 1996.

[9] OLIVEIRA, Maxwell Ferreira de. Metodologia Científica: um manual para a realização de pesquisas em administração. um manual para a realização de pesquisas em administração. 2011. UNIVERSIDADE FEDERAL DE GOIÁS – CAMPUS CATALÃO – CURSO DE ADMINISTRAÇÃO. Disponível em: https://files.cercomp.ufg.br/weby/up/567/o/Manual_de_metodologia_cientifica_-_Prof_Maxwell.pdf. Acesso em: 04 mar. 2024.

[10] FLORIDI, Luciano; CHIRIATTI, Massimo. GPT-3: its nature, scope, limits, and consequences. Minds And Machines, [S.L.], v. 30, n. 4, p. 681-694, 1 nov. 2020. Springer Science and Business Media LLC. http://dx.doi.org/10.1007/s11023-020-09548-1.

[11] MÜLLER, William Henrique; SILVEIRAS, Raphael. A Evolução E A Regulamentação Da Inteligência Artificial No Brasil: uma perspectiva histórica e conceitual. Revista Interciência, Catanduva, v. 1, n. 11, p. 2-10, jul. 2023. IMES Catanduva. Disponível em: https://edisciplinas.usp.br/mod/resource/view.php?id=4982647. Acesso em: 05 mar. 2024.

[12] FLORIDI; CHIRIATTI, ref. 10.

[13] ARUDA, Eucidio Pimenta. Inteligência artificial generativa no contexto da transformação do trabalho docente. Educação em Revista, [S.L.], v. 40, p. 1-6, 2024. FapUNIFESP (SciELO). http://dx.doi.org/10.1590/0102-469848078.

[14] SANTO, Eniel do Espírito; ROSA, Flávia Goulart Mota Garcia; SILVA, Camila Bezerra da; BORDAS, Miguel Angel Garcia. Um mosaico de ideias sobre a inteligência artificial generativa no contexto da educação. In: ALVES, Lynn (org.). Inteligência artificial e educação: refletindo sobre os desafios contemporâneos. Salvador / Feira de Santana: Editora da Universidade Federal da Bahia / UEFS Editora, 2023. Cap. 3. p. 51-69.

[15] Ibid., p. 54.

[16] NATURE. Tools such as ChatGPT threaten transparent science; here are our ground rules for their use. Editorial, 2023. Disponível em: https://www.nature.com/articles/d41586-023-00191-1. Acesso em: 15 mai. 2024.

[17] BARRETO, Alana Maria Passos; ÁVILA, Flávia de. A inteligência artificial diante da integridade científica: um estudo sobre o uso indevido do ChatGPT. Revista Direitos Culturais, [S.L.], v. 18, n. 45, p. 91-106, 7 set. 2023. Universidade Regional Integrada do Alto Uruguai e das Missões. http://dx.doi.org/10.31512/rdc.v18i45.1373.

[18] NATURE. Para autores: Submissão inicial. 2024. Disponível em: https://www.nature.com/nature/for-authors/initial-submission. Acesso em: 15 mai. 2024.

[19] Ibid.

[20]GONÇALVES, Felipe Halex Gomes da Silva; SALLES, Juliana Marques. Como se comporta a inteligência artificial mediante plágio e direito autoral. Revista Científica Eletrônica de Ciências Aplicadas da FAIT, Itapeva, n. 22, p. 1-14, maio 2023.

[21] HERNANDES, ref. 2.

[22] BARRETO; ÁVILA, ref. 17.

[23] PRADO, Magaly. O poder da inteligência artificial no cruzamento entre ChatGPT e deepfakes. Jornal da USP. Jul. 2023. Disponível em https://jornal.usp.br/artigos/o-poder-da-inteligencia-artificial-no-cruzamento-entre-chatgpt-e-deepfakes/. Acesso em 13 mar. 2024.

[24] Ibid.

[25] BARRETO; ÁVILA, ref. 17.

[26] BRASIL. Projeto de Lei nº 2.338. Publicado em 04 de maio de 2023. Dispõe sobre o uso da Inteligência Artificial. Brasília, DF: Câmara dos Deputados, 2023. Disponível em: https://www25.senado.leg.br/web/atividade/materias/-/materia/157233. Acesso em: 14 mar. 2024.

[27] TEIXEIRA, Pedro S.. ChatGPT está nos tribunais por plágio e difamação, mas tema ainda não chegou ao Brasil. 2023. Artigo publicado por Folha de São Paulo em 30 de agosto de 2023. Disponível em: https://www1.folha.uol.com.br/tec/2023/08/chatgpt-esta-nos-tribunais-por-plagio-e-difamacao-mas-tema-ainda-nao-chegou-ao-brasil.shtml. Acesso em: 15 mar. 2024.

[28] BRASIL, ref. 26, art. 42.

[29] Ibid., art. 24.

[30] BRASIL. Lei Nº 9.610, de 19 de fevereiro de 1998. Altera, atualiza e consolida a legislação sobre direitos autorais e dá outras providências. Brasília, Disponível em: https://www.planalto.gov.br/ccivil_03/leis/l9610.htm. Acesso em: 15 mar. 2024.

[31] NATURE, ref. 16.

[32] SOUZA, Elaine Antônia de. A Gestão Escolar E As Tecnologias Digitais: a implementação de um projeto e os desafios da prática pedagógica. 2022. 152 f. Dissertação (Doutorado) – Curso de Educação (Área de Especialidade em Administração Educacional), Instituto de Educação, Universidade de Lisboa, Lisboa, 2022. Disponível em: https://repositorio.ul.pt/handle/10451/56663. Acesso em: 15 abr. 2024. p. 93.

[33] Ibid.

[34] ARUDA, ref. 13, p. 3.

[35] BRASIL, ref. 26.

[36] Ibid.

[37] Ibid.

[38] KIRCHNER, Jan Hendrik; AHMAD, Lama; AARONSON, Scott; LEIKE, Jan. Novo classificador de IA para indicar texto escrito por IA. 2023. Elaborado por OpenAI. Disponível em: https://openai.com/blog/new-ai-classifier-for-indicating-ai-written-text. Acesso em: 15 abr. 2024.

[39] FERRARI, Leon. Perguntamos ao ChatGPT: Como a inteligência artificial muda o ensino e como lidar com o plágio? 2023. Artigo publicado por Estadão em 31 de janeiro de 2024. Disponível em: https://www.estadao.com.br/educacao/perguntamos-ao-chatgpt-quais-impactos-ele-pode-causar-na-educacao-confira-as-respostas/. Acesso em: 15 mar. 2024.